Зачем создавать файл robots.txt для сайта, размещенного на WordPress, и каким образом его лучше настроить? Неправильное использование этого файла может повредить индексации сайта и его продвижению в поисковых системах.

Корректная настройка избавит от дублей страниц и скроет ненужные страницы из результатов поиска.

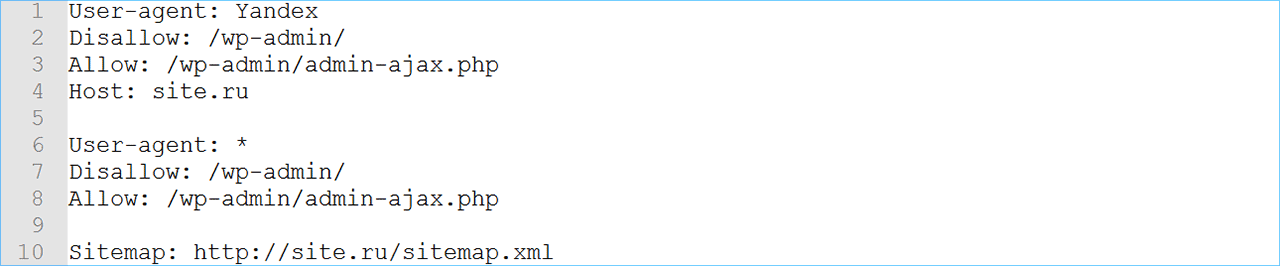

Самый простой пример файла robots.txt для WordPress, который закрывает только администраторскую панель:

Стандартный установщик Вордпресс не содержит файл роботс. Поэтому после установки CMS Вам потребуется создать его самостоятельно. В нашей статье вы найдете исчерпывающую информацию о всех командах, которые содержатся в этом файле. Также мы предлагаем Вам готовый работающий код для этого файла — вам достаточно скопировать его в свой файл роботс. Все что вам нужно сделать — создать свой файл, скопировать в него код, и добавить его в корневую папку Вашего сайта. После этого проверьте его коррекность для поисковых систем по нашей инструкции.

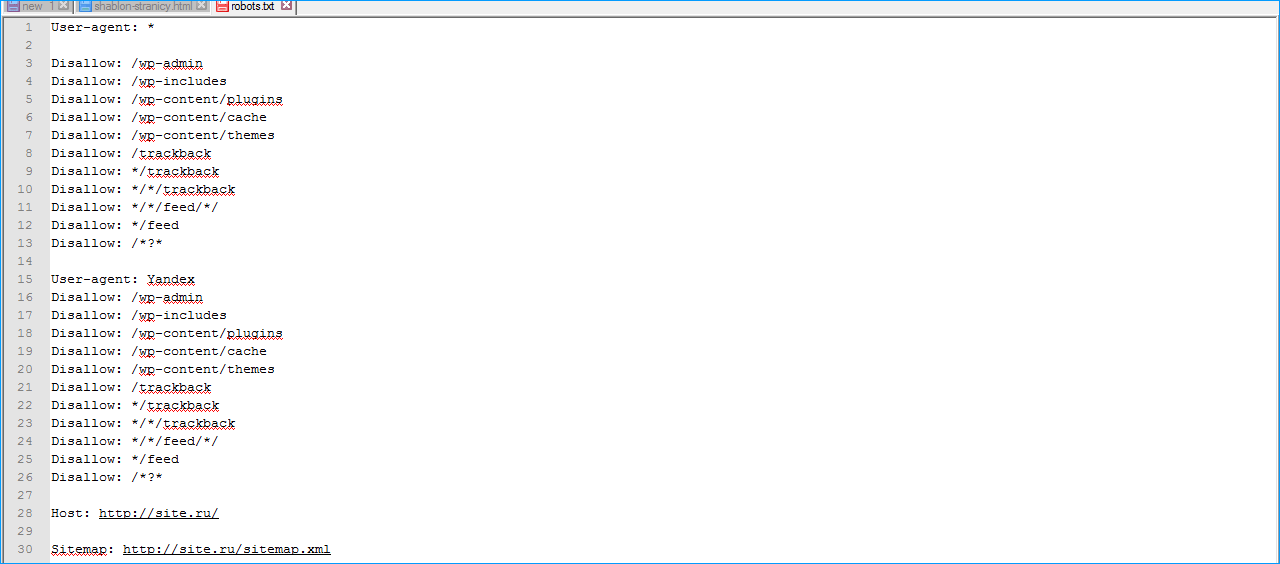

Вы можете выделить этот код и вставить на свой wordpress-сайт, заменив ссылки в разделе Host и Sitemap на адрес своего сайта.

User-agent: *

Disallow: /wp-admin

Disallow: /wp-includes

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /trackback

Disallow: */trackback

Disallow: */*/trackback

Disallow: */*/feed/*/

Disallow: */feed

Disallow: /*?*

User-agent: Yandex

Disallow: /wp-admin

Disallow: /wp-includes

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /trackback

Disallow: */trackback

Disallow: */*/trackback

Disallow: */*/feed/*/

Disallow: */feed

Disallow: /*?*

Host: http://site.ru/

Sitemap: http://site.ru/sitemap.xml

Файл robots.txt представляет собой простой текстовый файл, который вы можете создать в любом текстовом редакторе. Все инструкции, которые используются в robots.txt приводят к одному из трех результатов:

Часто возникают разногласия по поводу того, что следует помещать в файл robots.txt. Имейте в виду, что этот файл не предназначен для решения проблем безопасности веб-сайта, поэтому если требуется закрыть роботам доступ к частному контенту, необходимо защитить паролем область, где хранится такая информация.

Как правило, файл robots.txt призван служить руководством для поисковиков, но они могут и не соблюдать эти инструкции. Вариант файла robots.txt приведен на скриншоте.

Давайте разберем, какие функции выполняет каждая строка в этом файле. Директива User-agent обозначает группу инструкций, предназначенных одному роботу или всем сразу. Существует два варианта ее применения:

Разработчиками Яндекса отмечается, если в User-agent напрямую указан робот этой поисковой системы, то следует повторить в этом разделе те же общие инструкции, что используются для других поисковых роботов (строки 15-24). В противном случае роботом Яндекса будут учитываться только те команды, которые прописаны для него явно и проигнорируются остальные.

Директива Disallow информирует роботов, какие директории не требуется индексировать. Например, если нужно, чтобы поисковики не индексировали фотографии на сайте, поместите файлы с этими фотографиями в одну папку и закройте к ней доступ.

Для сайта, созданного на WordPress, обязателен запрет на индексацию админки, то есть папки wp-admin. Дополнительно можно запретить индексацию рубрик, архивов и тэгов, хотя при использовании SEO-плагинов на WordPress эти запреты устанавливаются в настройках плагинов. В приведенном примере также от возможного попадания в индекс закрыты папки шаблона и кешированного контента.

Директива Allow позволяет сообщить роботу, что он может увидеть файл в папке, запрещенной другими инструкциями. В примере этой директивы нет, т.к. этот файл работает по принципу «что не запрещено – то разрешено».

Директива Host сообщает об адресе основного зеркала сайта. Команда Sitemap предназначена для любых роботов, она отмечает расположение xml-файла со структурой сайта и облегчает индексацию страниц поисковиками.

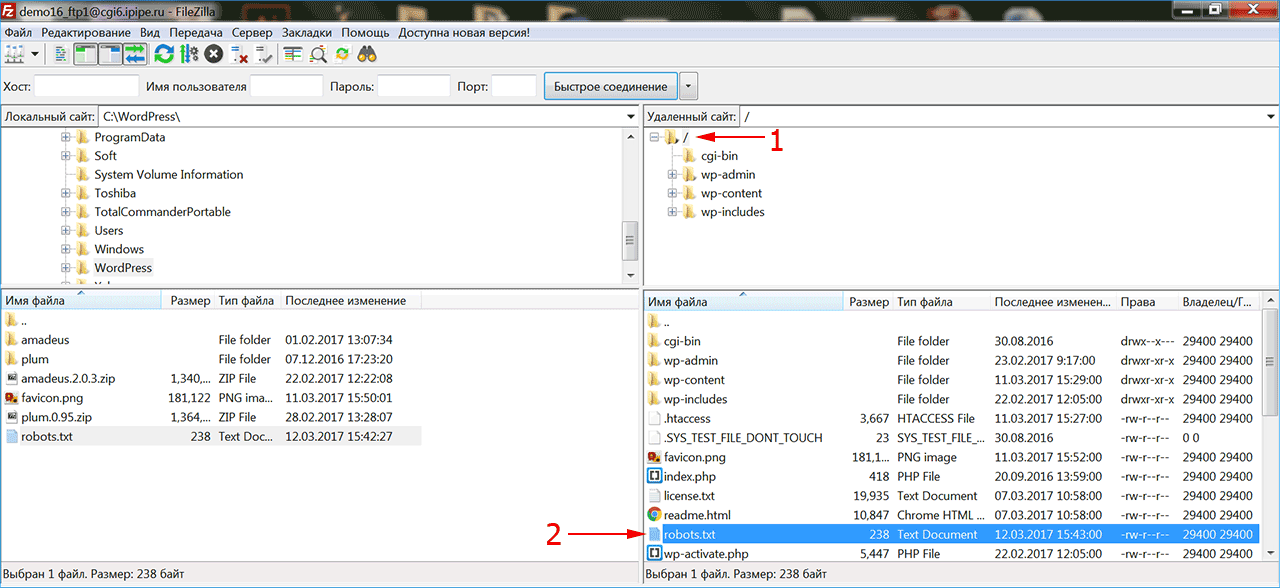

При отсутствии на сайте файла robots.txt, следует его создать. Можно использовать программу «Notepad++» в среде Windows или «TextEdit» для Mac.

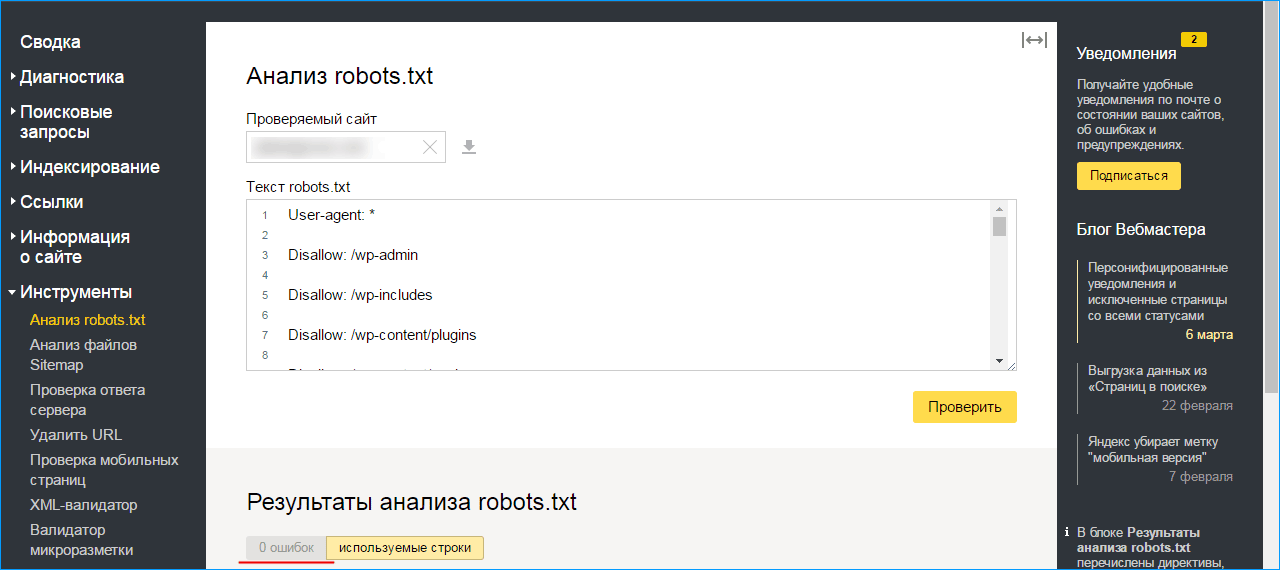

Рекомендуется протестировать файл robots.txt, чтобы проверить, что он работает именно таким образом, как ожидается от помещенных в него инструкций. Перед анализом, убедитесь, что сайт зарегистрирован в инструментах веб-мастера, которые предлагаются поисковиками Google и Яндекс.

Для проверки Яндексом перейдите в кабинет веб-мастера по ссылке https://webmaster.yandex.ru. Выберите меню «Инструменты» и подменю «Анализ robots.txt».

Чтобы проверить файл в Google пройдите по ссылке https://www.google.com/webmasters/tools. В меню «Сканирование» нужно выбрать пункт «Инструмент проверки файла robots.txt».

Обе системы позволяют отправить файл robots.txt на проверку, после чего выдают результаты анализа и сообщения об ошибках, если они были обнаружены.

Файл robots.txt – обыкновенный текстовый документ, размещенный на веб-сервере, он сообщает поисковым роботам о доступе к разделам сайта. При использовании этого файла можно задавать инструкции, например, запретить поисковикам индексировать служебные файлы и категории сайта, указать основную версию сайта и путь к карте сайта в формате xml. Прежде чем поисковик проиндексирует сайт, на него зайдет робот, например, Googlebot или Yandex, и просканирует файл robots.txt на предмет команд о том, какие страницы разрешено посещать и сохранять в результатах поиска.

Чтобы проверить, имеется ли на сайте файл robots.txt, задайте в адресной строке /robots.txt сразу после названия домена. В случае когда этот файл отсутствует, роботы-поисковики обладают полным доступом к вашему сайту. При этом в выдаче поиска могут оказаться ссылки на админпанель и вся информация, которую следует скрыть от посторонних. В связи с этим выделяют ряд причин, по которым потребуется использование файла robots.txt:

Каждая из этих ситуаций может быть исправлена разными способами, однако настройка файла robots.txt поможет реализовать их все сразу в одном месте, поскольку большинство веб-мастеров имеют доступ к сайту, необходимый для создания и использования файла robots.txt.

iPipe – надёжный хостинг-провайдер с опытом работы более 15 лет.

Мы предлагаем: